Содержание

- 0.1 Алфавитный подход позволяет измерять количество информации в тексте (символьном сообщении), составленном из символов некоторого алфавита.

- 0.2 Алфавит – это набор букв, знаков, цифр, скобок и т.д. Количество символов в алфавите называется его мощностью .

- 0.3 Какова минимальная мощность алфавита, с помощью которого можно записывать (кодировать) информацию?

- 0.4 Односимвольный алфавит

- 0.5 Двоичный алфавит

- 0.6 Теория:

- 0.7 Содержание урока

- 1 §3. Измерение информации

Как можно измерить количество информации? Да также, как мы измеряем длину или массу чего-нибудь: сравнить с соответствующим эталоном. Сколько раз эталонная единица укладывается в измеряемой величине, таков и результат измерения. Надо только выбрать эталон.

Например, в мультфильме «38 попугаев» эталоном длины служит длина шага попугая.

Каков же эталон для измерения информации? Давайте в этом разберемся.

Существует несколько способов измерения количества информации. Один из них называется алфавитный.

Алфавитный подход позволяет измерять количество информации в тексте (символьном сообщении), составленном из символов некоторого алфавита.

К содержанию текста такая мера информации отношения не имеет. Поэтому такой подход можно назвать объективным, то есть не зависящим от воспринимающего его субъекта.

Алфавитный подход удобен при подсчете количества информации, хранимого, передаваемого и обрабатываемого техническими устройствами. Устройствам нет дела до содержательной стороны сообщений. Компьютеры, принтеры, модемы работают не с самой информацией а с ее представлением в виде сообщений. Оценить информационные результаты их работы как полезные или бесполезные может только человек.

Алфавит – это набор букв, знаков, цифр, скобок и т.д.

Количество символов в алфавите называется его мощностью .

Например, мощность алфавита из русских букв и дополнительных символов:

33 буквы + 10 цифр + 11 знаков препинания + скобки + пробел = 54

При алфавитном подходе считается, что каждый символ текста имеет определенный информационный вес. Информационный вес символа зависит от мощности алфавита.

Какова минимальная мощность алфавита, с помощью которого можно записывать (кодировать) информацию?

Односимвольный алфавит

Сообщение любой длины, использующее односимвольный алфавит, содержит нулевую информацию.

Предположим, что используемый алфавит состоит из одного символа, например, буквы «А». Интуитивно понятно, что сообщить что-либо с помощью единственного символа невозможно.

Двоичный алфавит

Двоичный алфавит состоит из 2-х символов: и 1 .

Информационный вес символа двоичного алфавита называется 1 бит .

Следовательно, 1 бит – это 0 или 1 .

Назовем комбинацию из 2-х, 3-х и т.д. бит двоичным кодом.

Теория:

В двоичном коде один двоичный разряд несет одну единицу информации, которая называется 1 бит .

Например, в (2)-символьном алфавите каждый символ «весит» (1) бит ( log 2 2 = 1 ); в (4)-символьном алфавите каждый символ несет (2) бита информации ( log 2 4 = 2 ); в (8)-символьном — (3) бита ( log 2 8 = 3 ) и т. д.

Содержание урока

§1. Информатика и информация

§2. Что можно делать с информацией?

§3. Измерение информации

Что такое бит?

§3. Измерение информации

Что такое бит?

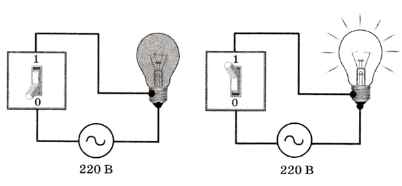

Рассмотрим электрическую лампочку, которая может находиться в двух состояниях: «горит» и «не горит». Тогда на вопрос «Горит ли сейчас лампочка» есть два возможных варианта ответа, которые можно обозначить цифрами 1 («горит») и 0 («не горит») (рис. 1.5). Поэтому ответ на этот вопрос (полученная информация) может быть записан как 0 или 1 1 .

1 Конечно, вместо 0 и 1 можно использовать два любых знака.

Цифры 0 и 1 называют двоичными, и с этим связано название единицы измерения количества информации — бит. Английское слово bit — это сокращение от выражения binary digit — «двоичная цифра». Впервые слово «бит» в этом значении использовал американский инженер и математик Клод Шеннон в 1948 г.

Бит — это количество информации, которую можно записать (закодировать) с помощью одной двоичной цифры.

Бит — это количество информации, которую можно записать (закодировать) с помощью одной двоичной цифры.

Конечно, нужно договориться, что означают 0 и 1 (1 — это «горит» или «не горит»?), но для измерения количества информации это не важно.

Например, в сообщении «подброшенная монета упала гербом» содержится 1 бит информации, потому что монета могла упасть гербом (обозначим это через 0) или «решкой» (1). Сообщение «Дверь открыта» тоже содержит 1 бит, если считать, что дверь может быть в двух состояниях: открыта (0) или закрыта (1). Вот ещё пример диалога, в котором получена информация в 1 бит:

— Вы будете чай или кофе?

2 бита, 3 бита.

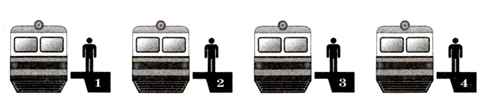

А если возможных вариантов не два, а больше? Понятно, что в этом случае количество информации будет больше, чем 1 бит. Представим себе, что на вокзале стоят 4 одинаковых поезда (рис. 1.6), причём только один из них проследует в Москву. Сколько битов понадобится для того, чтобы записать информацию о номере платформы, где стоит поезд на Москву?

Очевидно, что одного бита недостаточно, так как с помощью одной двоичной цифры можно закодировать только два варианта — коды 0 и 1. А вот два бита дают как раз 4 разных сообщения: 00, 01, 10 и 11. Теперь нужно сопоставить эти коды номерам платформ, например, так: 1 — 00, 2 — 01, 3 — 10, 4 — 11. Тогда сообщение 10 говорит о том, что поезд на Москву стоит на платформе № 3. Это сообщение несёт 2 бита информации.

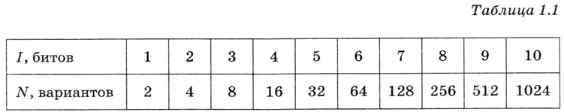

Три бита дают уже 8 вариантов: 000, 001, 010, 011, 100, 101, 110 и 111. Таким образом, каждый бит, добавленный в сообщение, увеличивает количество вариантов в 2 раза (табл. 1.1).

Наверно, вы заметили, что все числа в нижней строчке таблицы — это степени числа 2: N = 2 I .

Осталось выяснить, чему равно количество информации, если выбор делается, скажем, из 5 возможных вариантов (или из любого количества, не являющегося степенью числа 2). С точки зрения приведённого выше рассуждения случаи выбора из 5, 6, 7 и 8 вариантов не различаются — для кодирования двух двоичных цифр мало, а трёх — достаточно. Поэтому использование трёх битов для кодирования одного из 5 возможных вариантов избыточно, ведь три бита позволяют закодировать целых 8 вариантов! Значит, выбор из 5 вариантов даёт меньше трёх битов информации.

Чтобы количественно измерить разницу между, скажем, 5 и 8 вариантами, придется допустить, что количество информации в битах может быть дробным числом. При этом информация, полученная при выборе из 5 вариантов, больше, чем 2 бита, но меньше, чем 3 бита. Точную формулу для ее вычисления получил в 1928 г. американский инженер Ральф Хартли. Эта формула использует понятие логарифма, поэтому мы познакомимся с ней в 11 классе.

Тем не менее уже сейчас вы можете оценить количество информации при выборе из 5 вариантов. Допустим, на завтрак в лагере отдыха каждый день дают кашу одного из 5 видов. Чтобы закодировать вид каши, которую дают в понедельник, нужно, как мы знаем, 3 бита. Но меню на два дня может быть составлено 25 разными способами (5 • 5), поэтому для его кодирования достаточно 5 битов, ведь 25 5 ! Тогда получается, что количество информации при выборе информации из 5 вариантов меньше, чем 5/2 = 2,5 бита. Но и эту оценку можно уточнить. Для трёх дней получаем 5 • 5 • 5 = 125 вариантов. Так как 125 7 , количество информации при выборе из 5 вариантов составляет не больше, чем 7/3 = 2,33 бита. И так далее. Попробуйте самостоятельно показать, что при выборе из 5 вариантов количество информации больше 2,25 бита. Верно ли, что при выборе из 6 вариантов количество информации менее 2,5 бита?

Следующая страница  Другие единицы

Другие единицы

Cкачать материалы урока